Exposer votre SaaS aux agents IA

Vos données métier deviennent interrogeables en langage naturel depuis Claude, ChatGPT, ou Cursor.

Product Engineering • Expertise MCP

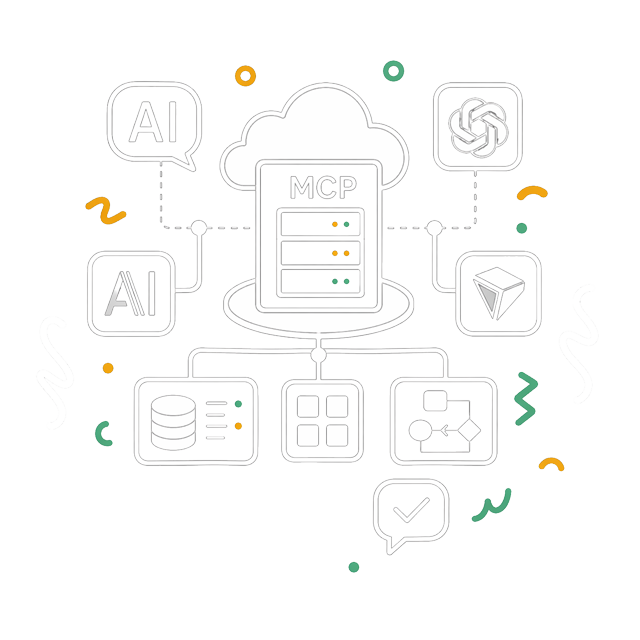

Votre produit devient activable par Claude, ChatGPT, Cursor et tous les agents IA compatibles. Vos données, vos fonctionnalités, vos workflows, consultables dans une conversation avec une IA.

En 2012 il fallait avoir une app mobile, en 2016 une API publique, et en 2026 c'est le serveur MCP.

Un serveur MCP est un canal de distribution pour les IA. Un assistant IA peut répondre aux questions de vos utilisateurs grâce à vos données et les outils de votre SaaS. Sans serveur MCP, l'IA répond avec ses données génériques. Avec, elle interroge votre produit et cite vos données réelles.

L'enjeu est d'être présent dans la conversation des utilisateurs avec leur IA, au lieu d'attendre qu'ils viennent sur votre app.

Le Model Context Protocol (MCP) est un standard ouvert publié par Anthropic en novembre 2024. Un serveur MCP expose des outils (tools), chacun avec un nom, une description et des paramètres, qu'un agent IA lit, choisit et appelle directement dans une conversation.

C'est comme une API REST, mais le consommateur n'est pas un développeur, c'est un LLM. Une API classique attend des appels et paramètres précis. Un serveur MCP, lui, laisse l'IA lire la liste de tools et décider elle-même lequel appeler selon ce que l'utilisateur demande.

Vos données deviennent citées et vos utilisateurs peuvent vous consommer depuis Claude, ChatGPT, ou Cursor sans jamais ouvrir votre app.

Trois scénarios où un serveur MCP change la donne pour un produit :

Vos données métier deviennent interrogeables en langage naturel depuis Claude, ChatGPT, ou Cursor.

Notes, specs, articles, documents : un agent IA branché via MCP les résume, les recherche et les relie en langage naturel.

n8n, Claude Desktop, Cursor, ChatGPT : autant de clients MCP qui peuvent automatiser des tâches à partir de votre produit sans intégration custom.

De l'idée au serveur MCP déployé.

Quels tools exposer, à quelle audience IA, pour quelle donnée critique. De la clarté sur les capacités qui comptent.

Schéma JSON, nommage, descriptions rédigées comme un prompt, erreurs exploitables par le LLM.

Stack adaptée au besoin : FastMCP en Python, SDK TypeScript officiel, OAuth 2.1 pour les serveurs distants multi-utilisateurs, avec un mode d'enregistrement client adapté au contexte.

Mise en production, monitoring des appels réels, ajustement des descriptions selon le comportement observé des agents.

Les briques techniques que j'utilise, choisies selon le contexte du projet :

Un serveur MCP n'est pas une simple copie de l'API interne. Plus vous exposez de tools, plus l'IA se perd, consomme des tokens inutiles, et hallucine des appels hors contexte. La bonne règle, c'est de commencer petit et augmenter ensuite.

Sur mes deux serveurs MCP en production, j'ai volontairement créé seulement 3 tools :

La règle : un tool = une responsabilité claire. Pas de doublon, pas de « au cas où ».

La description des tools est lue par un LLM, pas par un humain. C'est un prompt. Si elle est vague, l'IA ne l'appellera jamais, ou pire, l'appellera à tort.

J'ai deux serveurs MCP en production sur mes propres SaaS :

Un utilisateur demande à Claude « audite la fiche Google de Boulangerie X à Lyon » et récupère un vrai rapport avec les données de Begonia.pro, pas une réponse générique.

Begonia.proLe MCP sert à exposer des documents Markdown. L'utilisateur peut demander « rédige un article pour mon blog sur le sujet XXXX en analysant le style d'écriture de mes autres articles ».

Fude.mdLes questions à propos des serveurs MCP :

Que vous ayez un SaaS existant ou une idée à explorer, parlons-en. Je vous aide à identifier les bons tools, à concevoir un serveur MCP utile, et à le déployer proprement.